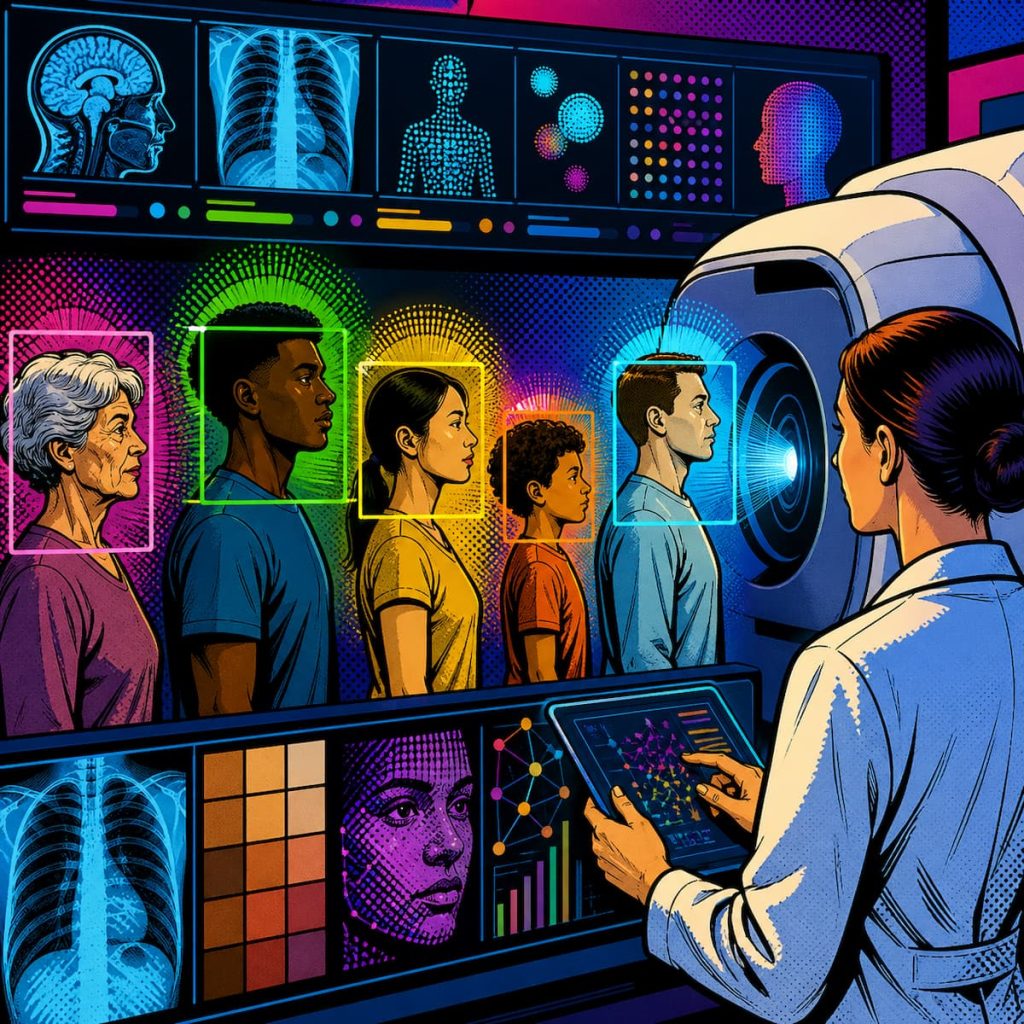

¿Qué ocurre cuando los datos que alimentan a un algoritmo ya contienen desigualdad? La inteligencia artificial aplicada a la salud suele presentarse bajo una apariencia de neutralidad técnica, como si la matemática pudiera operar al margen de las fracturas sociales. Pero ningún algoritmo nace fuera del mundo. Aprende de registros clínicos, imágenes médicas, costes hospitalarios, diagnósticos previos, ensayos, historiales incompletos y decisiones humanas acumuladas durante décadas. Allí donde una enfermedad fue menos investigada, un colectivo peor atendido, una piel menos representada, un síntoma minimizado o un territorio con menor acceso al sistema sanitario, la tecnología puede transformar una carencia histórica en una recomendación aparentemente objetiva.

La cuestión central, por tanto, no consiste en enfrentar medicina e inteligencia artificial, ni en oponer médicos contra máquinas. El verdadero debate se sitúa en otro lugar: cómo integrar herramientas de enorme potencia sin entregarles una autoridad clínica que todavía exige supervisión humana, responsabilidad institucional y lectura crítica. La inteligencia artificial puede ayudar a detectar patrones invisibles, acelerar diagnósticos, priorizar pacientes y optimizar recursos. También puede amplificar sesgos si ha sido entrenada con datos incompletos, si se aplica en poblaciones distintas de aquellas para las que fue validada o si sus resultados se aceptan como una verdad incuestionable.

Los principales organismos sanitarios y reguladores han empezado a reconocer esta tensión. La inteligencia artificial en salud puede mejorar procesos clínicos, administrativos y científicos, pero plantea riesgos cuando opera con datos de baja calidad, modelos opacos o sistemas insuficientemente auditados. En el ámbito médico, esos riesgos adquieren una gravedad particular porque afectan a decisiones sobre diagnóstico, tratamiento, seguimiento y acceso a recursos. Un fallo algorítmico no es solo un error informático: puede convertirse en una demora asistencial, una sospecha descartada, una prioridad mal asignada o una desigualdad reproducida bajo apariencia tecnológica.

Europa ha empezado a responder a este desafío mediante una regulación específica. Los sistemas de inteligencia artificial considerados de alto riesgo, entre ellos aquellos que pueden afectar a la salud o a derechos fundamentales, deben cumplir exigencias reforzadas de gobernanza de datos, documentación técnica, transparencia, supervisión humana, precisión, solidez y ciberseguridad. En el caso de la medicina, estas obligaciones resultan especialmente relevantes porque muchos sistemas de IA no son simples aplicaciones informáticas, sino productos sanitarios o componentes integrados en dispositivos médicos. La tecnología médica, por tanto, queda situada en una zona de máxima responsabilidad: debe ser innovadora, pero también verificable; útil, pero también segura; eficiente, pero también justa.

Uno de los aspectos más sensibles es la calidad de los datos. Los conjuntos de entrenamiento, validación y prueba deben ser representativos, pertinentes y suficientemente completos para la finalidad prevista. También deben examinarse los sesgos que puedan afectar a la salud, la seguridad o los derechos fundamentales. Esta exigencia no es un detalle técnico menor. Constituye el núcleo ético de la medicina algorítmica. Un sistema puede alcanzar buenos resultados generales y, al mismo tiempo, fallar de manera sistemática en determinados grupos de población. La precisión media puede ocultar una injusticia concreta.

Un caso especialmente revelador procede del uso de algoritmos para gestionar programas de atención a pacientes con necesidades complejas. Determinados sistemas utilizaron el coste sanitario como sustituto de la necesidad médica. A primera vista, la variable podía parecer razonable: quienes generan más gasto podrían requerir más atención. Sin embargo, ese razonamiento escondía una distorsión profunda. Si determinados grupos sociales acceden menos al sistema, reciben menos pruebas, menos seguimiento o tratamientos más tardíos, también generan menos gasto. El algoritmo interpreta entonces ese menor gasto como menor necesidad, cuando en realidad puede estar leyendo una historia previa de desatención.

Ese ejemplo muestra la trampa fundamental: una variable aparentemente técnica puede contener una biografía social. El coste no siempre mide enfermedad; a veces mide acceso. El registro no siempre refleja necesidad; a veces refleja abandono. La máquina, al obedecer al dato, hereda también su historia. Y esa historia no siempre habla de biología, sino de renta, territorio, edad, género, origen, confianza institucional, cobertura sanitaria y trato recibido.

La imagen médica, uno de los campos más prometedores de la inteligencia artificial, tampoco escapa a esta problemática. En radiología, dermatología u oftalmología, los modelos pueden detectar patrones de enorme complejidad, pero también pueden aprender atajos demográficos. Un sistema entrenado con determinadas poblaciones puede comportarse peor cuando se aplica a otras. Un algoritmo aparentemente eficaz en un hospital, un país o un conjunto de imágenes puede perder fiabilidad cuando se traslada a contextos clínicos distintos. La medicina real nunca es un laboratorio perfectamente cerrado: es una red de cuerpos diversos, historias clínicas fragmentarias y condiciones sociales desiguales.

La dermatología ofrece un ejemplo particularmente claro. La piel, que debería estar representada en toda su diversidad, ha padecido históricamente una presencia desigual en manuales, bancos de imágenes y materiales docentes. Si los sistemas de inteligencia artificial se entrenan con imágenes que sobrerrepresentan determinados tonos de piel y excluyen otros, el riesgo clínico es evidente: lesiones peor detectadas, diagnósticos más tardíos y herramientas menos seguras para quienes ya estaban insuficientemente representados. La tecnología, en ese caso, no corrige la desigualdad previa; puede prolongarla con una nueva autoridad visual.

La irrupción de los grandes modelos de lenguaje añade otra capa de complejidad. Estas herramientas empiezan a utilizarse para resumir historiales, redactar informes, orientar decisiones, responder dudas de pacientes o apoyar tareas administrativas. Su capacidad verbal puede resultar convincente, incluso cuando la respuesta contiene errores, simplificaciones o sesgos. En medicina, la forma no puede confundirse con la verdad. Una respuesta bien redactada no equivale necesariamente a una recomendación clínicamente válida. Por eso resulta imprescindible auditar estos modelos con criterios rigurosos, escenarios reales y participación de profesionales sanitarios, pacientes, expertos en ética, juristas y responsables institucionales.

La medicina algorítmica exige una nueva cultura de verificación. La pregunta ya no puede limitarse a si un sistema acierta en términos generales. Importa saber en quién acierta, en quién falla, con qué datos fue entrenado, qué poblaciones quedaron fuera, en qué contexto se validó, qué margen de supervisión humana existe y quién asume la responsabilidad cuando una recomendación contribuye a un daño. La eficacia técnica debe dialogar con la justicia clínica. Un algoritmo puede ser estadísticamente brillante y socialmente insuficiente.

Esta reflexión no conduce al rechazo de la inteligencia artificial en medicina. Su potencial es real. Puede mejorar diagnósticos, reducir tiempos, asistir a profesionales sobrecargados, acelerar investigación biomédica y facilitar una atención más personalizada. La clave está en evitar que la fascinación tecnológica sustituya al juicio crítico. La innovación sanitaria necesita datos de calidad, auditorías independientes, transparencia, validación en entornos diversos, supervisión humana efectiva y marcos regulatorios capaces de proteger al paciente sin paralizar el avance científico.

El futuro de la salud digital dependerá menos del brillo de la herramienta que de la responsabilidad con la que se incorpore. La inteligencia artificial puede ayudar a mirar mejor el cuerpo humano, pero solo si antes se examina el origen de su mirada. En medicina, el dato nunca es una cifra desnuda: es una huella. Y toda huella procede de una historia. El gran desafío de la medicina algorítmica consistirá en impedir que los prejuicios del pasado se presenten, mañana, con el prestigio frío de una decisión automática.