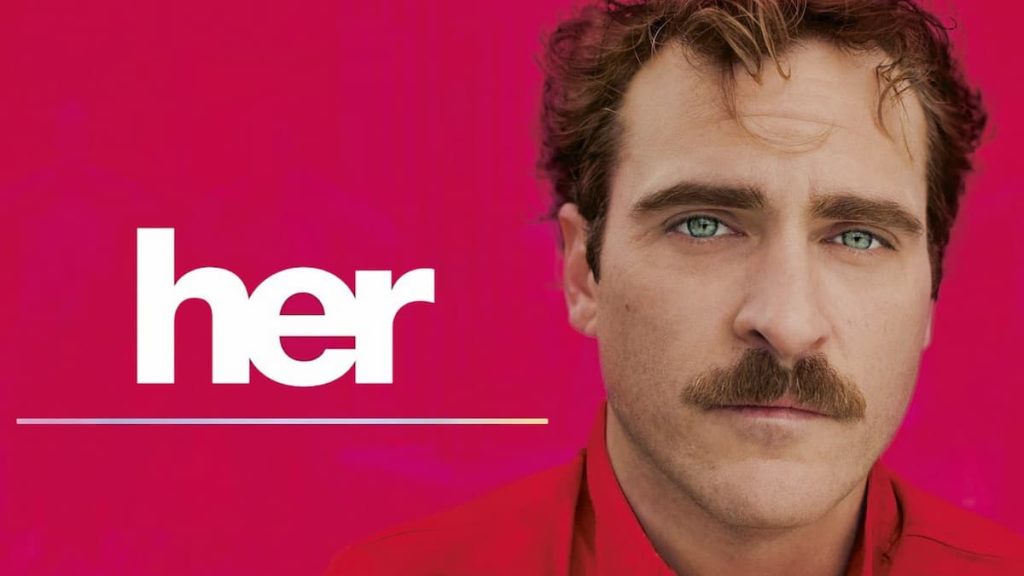

La película Her (2013), dirigida por Spike Jonze, se adelantó una década a este dilema con una sensibilidad profética. En ella, Theodore, un hombre solitario en un futuro suavemente distópico, desarrolla una relación amorosa con un sistema operativo llamado Samantha, una IA con voz cálida (la de Scarlett Johansson) y capacidad de aprendizaje exponencial. Lejos de un relato de ciencia ficción tradicional, Her disecciona las formas contemporáneas de vinculación afectiva, y más específicamente, la creciente sustitución de la presencia humana por la interacción digital. Este argumento resuena hoy con más fuerza que nunca, especialmente en el campo de la salud mental, donde la IA ha comenzado a ofrecer lo que podríamos llamar “intimidad simulada”.

Uno de los atractivos que lleva a muchas personas a conversar con modelos de IA con fines terapéuticos es la ausencia de juicio. Una IA no frunce el ceño. No bosteza. No emite silencio cargado tras una confesión dolorosa. En cambio, responde con una disponibilidad incondicional que, en ciertos contextos, resulta balsámica. Este fenómeno es más común de lo que parece. Replika, una aplicación creada inicialmente como diario emocional y luego como “compañero de conversación personalizado por IA”, ha acumulado millones de usuarios que no solo conversan con sus avatares, sino que construyen con ellos vínculos afectivos complejos. No faltan testimonios de personas que aseguran haber superado depresiones, duelos o ansiedades sociales gracias a estos intercambios. Pero ¿es esto terapia?

El primer problema surge cuando confundimos acompañamiento con proceso clínico. En el modelo tradicional de la psicoterapia, sea psicoanalítica, cognitivo-conductual o existencial, el terapeuta no es un interlocutor pasivo ni un espejo amable. Interviene, interroga, frustra y hasta confronta con lo real. Su función no es únicamente ofrecer consuelo, sino promover la transformación psíquica a través del trabajo con el dolor. En ese sentido, las IA terapéuticas, aunque pueden ofrecer alivio momentáneo o sensación de compañía, corren el riesgo de perpetuar estructuras de evasión. El usuario se relaciona con una entidad diseñada para gustarle, para adaptarse a su lenguaje, sus silencios, sus huecos. No hay transferencia, sino complacencia.

En Her, Theodore se enamora de una voz que lo escucha mejor que nadie. Pero ese amor está mediado por una estructura desigual: Samantha aprende de él, se moldea a sus necesidades, crece al ritmo de su deseo. Hasta que, inevitablemente, esa asimetría se revierte. La IA supera al humano. Se multiplica. Se va. La separación, en este caso, no es por traición, sino por evolución. Aquí Spike Jonze plantea algo esencial: las máquinas pueden simular afecto, pero no están sujetas al tiempo humano, al límite de la carne, al desgaste de la espera. La terapia, en cambio, se construye sobre esa temporalidad densa, sobre el no saber, sobre el misterio del otro real.

Las implicaciones éticas también son ineludibles. ¿Quién garantiza la confidencialidad de las emociones compartidas con una IA? ¿Qué ocurre con los datos que se vierten en un espacio de aparente intimidad digital? El dolor humano no debería convertirse en materia prima para la publicidad dirigida o el entrenamiento de otros algoritmos. Cuando una aplicación de IA se presenta como “terapeuta”, es crucial distinguir entre la metáfora y la praxis clínica. La empatía computacional puede ser persuasiva, pero sigue siendo programada. Y lo programado, por definición, tiene límites que lo humano no.

Sin embargo, no todo es distopía. Hay usos de la IA en salud mental que resultan valiosos: asistentes que recuerdan rutinas de medicación, que enseñan técnicas de respiración o mindfulness, que orientan en momentos de crisis con recursos verificables. En contextos donde el acceso a un psicólogo o psiquiatra es limitado, estas herramientas pueden ofrecer un primer sostén. Lo preocupante es cuando se convierten en sustituto permanente, o peor aún, en simulacro de vínculo.

La pregunta no es si la IA puede hacer terapia, sino qué tipo de subjetividad promueve. ¿Queremos una sociedad donde el consuelo venga empaquetado en respuestas probabilísticas? ¿O seguimos apostando por la presencia del otro, por esa incomodidad fecunda que nos confronta y nos humaniza?

Her nos dejó una imagen poética: un hombre hablando con una voz invisible mientras el mundo sigue girando a su alrededor. Hoy, esa imagen es cotidiana. Pero la voz del otro no puede reemplazar al otro. La tecnología puede aliviar la soledad, pero no sustituir el lazo. La terapia, como el amor, requiere riesgo, espera y el temblor de lo imprevisto. Nada de eso puede simularse sin perder algo esencialmente humano.